今日,苹果公司在其机器学习研究博客上发布了2024年”以人为本的机器学习”(HCML)研讨会的精选录像,重点展示了其在负责任AI开发方面的工作。

近3小时内容公开

该活动最初于2024年8月举行,汇集了苹果研究人员和学术专家,探讨了从模型可解释性到可访问性等各种议题,以及预测和预防AI发展可能带来大规模负面影响的策略。

以下是公开的全部视频列表:

- “通过与屏幕感知基础模型协作打造更好的用户界面”,Kevin Moran(中佛罗里达大学)

- “用户界面理解”,Jeff Nichols(苹果公司)

- “AI弹性界面”,Elena Glassman(哈佛大学)

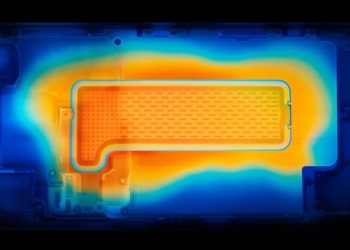

- “小而强大:支持高效设备端机器学习的人本研究”,Mary Beth Kery(苹果公司)

- “AI驱动的AR无障碍技术”,John Froehlich(华盛顿大学)

- “基于视觉的单次演示手势定制”,Cori Park(苹果公司)

- “创造超级听力:用AI增强人类听觉感知”,Shyam Gollakota(华盛顿大学)

苹果加倍重视负责任AI开发

尽管该活动已过去近一年,这些演讲仍然极具洞察力,因为它们主要关注机器学习开发中的人本和负责任方面,而非前沿技术本身。

在博文中,苹果还强调了其对负责任AI开发的关注,包括指导其AI工具开发的一系列原则:

- 用智能工具赋能用户:我们确定AI可以负责任应用的领域,为用户特定需求创建工具。我们尊重用户选择如何使用这些工具来实现目标。

- 代表我们的用户:我们打造深度个性化的产品,力求真实呈现全球用户。我们持续努力避免在AI工具和模型中延续刻板印象和系统性偏见。

- 精心设计:我们在设计、模型训练、功能开发和质量评估等每个阶段都采取预防措施,识别AI工具可能被滥用或造成潜在危害的情况。我们将借助用户反馈持续主动改进AI工具。

- 保护隐私:我们通过强大的设备端处理和Private Cloud Compute等突破性基础设施保护用户隐私。在训练基础模型时,我们不会使用用户的私人个人数据或交互记录。